每日經濟新聞 2026-03-09 19:58:33

每經編輯|蒙錦濤

2026年,自動駕駛行業迎來關鍵商業化窗口期。特斯拉在奧斯汀實現“車內無人”運營落地,國內百度蘿卜快跑和小馬智行也在多城加速布局。與此同時,工信部在2025年底發布首批L3級有條件自動駕駛車型準入許可,全國20個試點城市正推動“車路云一體化”從“有用”走向“能用”。

然而,喧囂的另一面是行業共識的悄然轉向:長尾問題——那些發生概率低但致命性高的邊緣場景,已成為高階自動駕駛規模化落地的真實瓶頸。在技術圈,有一個形象的比喻:99%的準確率決定演示效果,最后1%才決定生死。這最后的1%,正是由無數個“沒見過”的障礙物、“看不清”的逆光和“來不及反應”的突發狀況構成。

正是對這些“最后1%”場景的應對乏力,讓業界對感知系統可靠性的關注度,正在超越對算法精度的純粹追逐。從技術研發到量產應用,突破傳感器的物理極限,已成為行業跨越商業化門檻的當務之急。

自動駕駛的“最后1%”

自動駕駛的“最后1%”

長尾場景成為真實門檻

特斯拉CEO馬斯克近日在回應行業討論時指出,由于現實世界存在“極為龐大的長尾復雜性”,要實現安全的無監督自動駕駛,大約需要100億英里的訓練數據。這一判斷并非情緒化感慨,而是對自動駕駛技術門檻的清醒認知。

自動駕駛面臨的核心挑戰,在于真實道路環境由無數低概率、高風險、高耦合的極端情況構成。百度自動駕駛團隊的測試數據顯示,在暴雨天氣、強光逆光、不規則障礙物等邊緣場景中,L3級自動駕駛系統的通過率為75%至85%,遠低于人類駕駛員約98%的水平。

其中一個關鍵瓶頸來自感知系統本身。傳統視覺傳感器在復雜環境下的性能衰減十分明顯:在暴雨條件下,視覺識別距離可能下降60%;在強逆光場景中,攝像頭圖像甚至會出現大面積過曝,導致目標識別能力大幅下降。這些失效并非偶然,而是傳統幀式相機技術路徑的固有局限。

更棘手的是,自動駕駛系統所面對的大量長尾場景,很難通過有限的真實道路測試完全覆蓋。即使持續擴大數據規模,也難以窮盡所有極端情況。根據研究機構Gartner發布的智能駕駛技術成熟度曲線,目前感知系統的極端環境適應能力仍處于“泡沫破裂期”向“穩步爬升期”過渡階段,距離大規模成熟應用預計仍需3至5年時間。

這意味著,僅依靠擴大訓練數據規模,并不足以完全解決自動駕駛系統在復雜環境下的可靠性問題。越來越多產業參與者開始將注意力轉向另一個方向:從底層傳感器架構入手,提高系統在極端環境中的先天感知能力。

在這一背景下,事件相機(Dynamic Vision Sensor,DVS)正逐漸從實驗室走向產業應用。與以固定幀率持續采集完整圖像的傳統相機不同,DVS采用像素級異步工作機制:只有當某個像素的亮度變化超過設定閾值時,傳感器才會輸出該像素的位置、變化方向以及時間戳。這種“按需響應”的方式,使視覺系統不再依賴連續幀圖像,而是直接記錄場景變化,從而顯著減少冗余數據,同時提升對動態環境的感知能力。

由此帶來的優勢主要體現在三個方面:更快的響應速度、更強的光照適應能力以及更低的數據與能耗成本。首先是微秒級響應速度,DVS的時間分辨率達到微秒級,相比傳統相機每秒30至60幀的采樣方式提升數百倍,在自動駕駛場景中可在約30毫秒內捕捉突發狀況,例如突然竄出的行人或高速拋出的異物。其次是超高動態范圍,主流DVS產品動態范圍可達120至140分貝,在隧道進出、夜間或強逆光等極端光照條件下仍能穩定輸出感知信號,而傳統相機往往會因過曝或暗光而失效。

第三個優勢體現在系統效率上。由于僅在亮度變化時才產生事件數據,DVS能夠顯著減少圖像采集帶來的冗余信息,從而降低數據帶寬和整體功耗。這一特性對功耗敏感的移動平臺尤為重要,例如自動駕駛汽車和移動機器人。正是在這樣的技術背景下,越來越多企業開始嘗試將事件視覺引入自動駕駛感知體系,并在真實運營場景中進行驗證。

事件相機走向真實場景

事件相機走向真實場景

自動駕駛感知體系的一次技術驗證

理論上的技術優勢,最終仍需要通過真實場景驗證。但要將事件視覺技術從實驗室原型推向實際運營環境,本身也意味著跨越工程化、系統集成以及算法適配等多重技術門檻。

為此,柏銳智芯科技(成都)有限公司牽頭并聯合電子科技大學“人機智能技術與系統教育工程研究中心”、寧波時識科技有限公司、錦程智行(成都)智能技術有限公司(優必選子公司)、四川成路智匯科技有限公司(成都路橋子公司),圍繞事件視覺感知、多傳感器融合以及自動駕駛系統適配等關鍵技術開展聯合攻關。

在多方聯合攻關并完成系統集成與場景測試后,項目團隊于2026年1月在國內某大型機場集團的自動駕駛測試場景中,成功將DVS多模融合傳感器引入自動駕駛感知體系,并完成相關場景測試驗收。

據行業公開調研,這也是DVS多模融合傳感器在全球范圍內首次在L4級自動駕駛商用場景中的落地應用案例。業內人士認為,該案例為事件視覺技術在高等級自動駕駛中的實際應用提供了一次重要的工程化驗證。

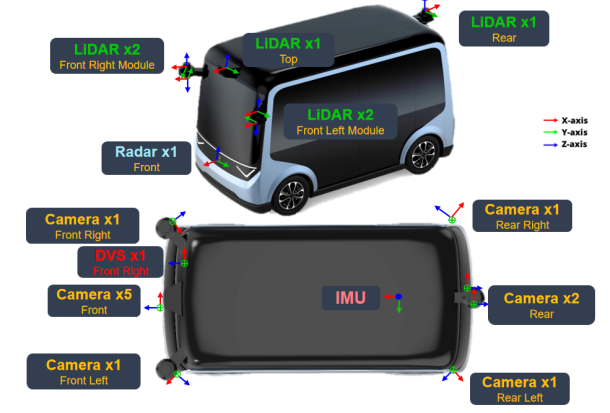

從具體技術實現來看,該系統采用的是多傳感器融合架構。在該系統架構中,車輛原本已經配備激光雷達、高清RGB相機和毫米波雷達等常規傳感器。但在強逆光、夜間眩光或突發動態目標等情況下,傳統視覺系統仍可能出現識別滯后。

為此,系統增加了一套DVS多模融合傳感器作為“高速觸發層”。當畫面中出現亮度快速變化時,DVS會率先捕捉這些動態信號,系統再對這些高速變化信息進行快速識別,并與其他傳感器的數據進行綜合判斷,從而更早觸發風險預警。

測試結果顯示,在夜間低照度環境下,當行人突然進入車輛前方形成典型“鬼探頭”情況時,DVS事件相機可以在約30毫秒內捕捉到人員出現并觸發系統響應,而傳統視覺系統在眩光干擾下識別明顯滯后。在白天強光環境測試中,當一個磚頭大小的異物突然出現在車輛行駛路徑上時,DVS同樣在約30毫秒內感知到動態變化并發出預警,而傳統視覺系統由于缺乏類似訓練樣本,未能及時識別。

在部分行業人士看來,這類基于事件視覺的感知方式,并不是對傳統視覺方案的替代,而更像是一種新的感知補充路徑。相比依賴大量訓練數據的識別模式,DVS更側重于對場景動態變化的實時捕捉,因此在部分極端環境中具備一定優勢。

伴隨自動駕駛、機器人以及工業自動化領域對低延遲視覺系統需求的持續增長,DVS技術的商業化進程也正在加速。權威數據顯示,全球動態視覺傳感器市場規模預計將從2025年的13.4億美元增長至2026年的14.9億美元,復合年增長率約11.2%。

在自動駕駛之外,DVS事件相機的應用場景也正在進一步拓展。在具身智能領域,機器人需要在復雜動態環境中進行快速感知與決策;而在快速發展的低空經濟領域,無人機、eVTOL等飛行器同樣對實時視覺系統提出更高要求。得益于微秒級響應速度和低數據冗余特性,DVS技術在高速運動感知、動態目標捕捉以及復雜光照環境適應方面展現出一定優勢。

業內普遍認為,隨著自動駕駛、機器人以及低空經濟等新興產業的持續發展,對高動態范圍、低延遲視覺系統的需求將不斷提升。能否將該技術從實驗室走向更大規模產業應用,也將成為未來智能感知體系演進的重要觀察方向。

編輯|蒙錦濤

如需轉載請與《每日經濟新聞》報社聯系。

未經《每日經濟新聞》報社授權,嚴禁轉載或鏡像,違者必究。

讀者熱線:4008890008

特別提醒:如果我們使用了您的圖片,請作者與本站聯系索取稿酬。如您不希望作品出現在本站,可聯系我們要求撤下您的作品。

歡迎關注每日經濟新聞APP